Как парсить веб-сайты [Полное руководство]

Веб-скрапинг, ранее считавшийся нишевым методом автоматизации, превратился в мощный подход для извлечения визуальных данных и данных с экрана из веб-сайтов, настольных приложений и устаревших систем.

Поскольку компании всё больше полагаются на цифровые данные, возросла потребность в скрин-скрейпинге, особенно когда традиционные методы скрейпинга блокируются или не работают.

В этом руководстве мы рассмотрим все, что вам нужно знать о скрейпинге веб-данных в 2026 году: как он работает, где он наиболее эффективен, где у него есть недостатки, а также какие инструменты и настройки дают вам наилучшее преимущество в рабочих процессах.

Что такое веб-скрейпинг

Скрин скрапинг — это процесс извлечения визуальных или отображаемых данных непосредственно с экрана компьютера, а не получения данных через бэкенд API или структурированный HTML.

Веб-скрапинг отличается от традиционного скрапинга тем, что он взаимодействует с данными, как они представлены визуально, либо копируя их из отрисованного HTML, используя оптическое распознавание символов (OCR) для чтения текста с изображений или графических пользовательских интерфейсов, либо автоматизируя взаимодействие с пользовательским интерфейсом приложения или платформы.

Скрапинг экрана против веб-скрапинга – в чем разница?

Хотя эти два понятия часто путают, парсинг экрана заключается в получении того, что отображается на экране, тогда как веб-скрейпинг нацелен на базовый HTML-код или структурированный контент.

Веб-скрапинг полезен, когда сайты используют динамический рендеринг JavaScript, Flash, или когда API серверной части недоступны или защищены.

Как веб-скрапинг извлекает визуальные данные

Современные методы парсинга веб-страниц опираются на комбинацию инструментов:

- Оптическое распознавание символов извлечь текст из изображений

- Безголовые браузеры, такие как Кукловод захватывать рендеры страниц

- UI автоматизации фреймворки симулировать ввод мыши и клавиатуры

- Парсинг на основе снимков экрана или CSS селектор Распознавание

Распространенные сценарии использования веб-скрапинга

Скрайпинг экрана особенно ценен в средах, где традиционный скрайпинг терпит неудачу или данные скрыты в визуальных компонентах.

Извлечение данных из устаревшего программного обеспечения

Устаревшие системы часто не имеют API или функций экспорта данных. Скрапинг экранов позволяет компаниям автоматизировать извлечение данных из устаревших приложений, особенно в таких секторах, как банковское дело или страхование.

Мониторинг финансовых и рыночных данных

Тре́йдеры и фина́нсовые анали́тики испо́льзуют скре́йпинг (извлече́ние) да́нных с дашбо́рдов и́ли термина́льных экра́нов для получе́ния ры́ночных цен в реа́льном вре́мени, информа́ции о сто́ках и анали́тики торго́в, когда́ API в реа́льном вре́мени рабо́тают с задержками и́ли явля́ются сли́шком доро́гими.

Тестирование пользовательского интерфейса и автоматизация

Инженеры по обеспечению качества используют методы извлечения данных с экрана (screen scraping) для проверки правильности отображения элементов пользовательского интерфейса или для тестирования автоматизированных пользовательских сценариев. Визуально проверяя положение и состояние элементов, тестировщики обеспечивают корректную работу приложения.

Отслеживание цен в реальном времени и оповещения

Интернет-магазины занимаются скрапингом данных из онлайн-магазинов конкурентов для отслеживания цен и наличия товаров, даже когда стандартные скраперы заблокированы.

В сочетании с OCR и динамическим рендерингом, веб-скрейпинг обеспечивает надежное извлечение ценников и этикеток товаров.

Преимущества и недостатки парсинга данных из интернета

Парсинг веб-страниц (screen scraping) — мощный инструмент, но он не лишен ограничений. Вот сбалансированный взгляд:

Плюсы:

- Работает, когда доступ к API или структурированным данным заблокирован

- Обходит проблемы динамического рендеринга или контент с интенсивным использованием JavaScript

- Идеально подходит для устаревших систем и графических приложений

- Полезно для захвата текста на основе изображений или CAPTCHA

Минусы:

- Более ресурсоемким, чем веб-скрапинг HTML

- Уязвим к изменениям пользовательского интерфейса (если изменится компоновка, скрапинг перестанет работать)

- Требуется высококачественное оптическое распознавание символов или фреймворки автоматизации

- Иногда медленнее и сложнее в масштабировании, чем парсинг HTML

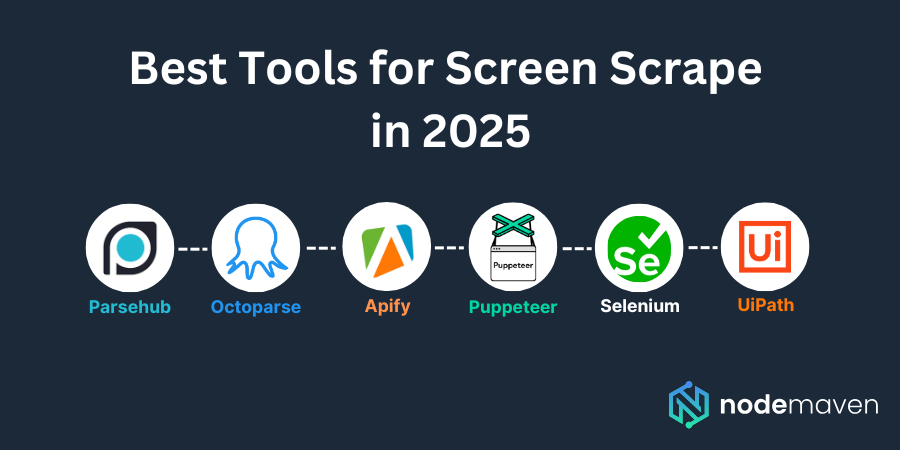

Лучшие инструменты для веб-скрейпинга в 2026

Выбор правильного инструмента имеет важное значение в зависимости от сложности вашего проекта, типа и объема данных. Вот лучшие инструменты для скрейпинга веб-страниц на 2026 год:

UiPath

UiPath, лидер в области роботизированной автоматизации процессов (RPA), идеально подходит для извлечения данных из унаследованных систем и настольных приложений. Его визуальный конструктор рабочих процессов и встроенные OCR-движки делают его удобным для пользователя.

Плюсы:

- Платформа без кода

- Интегрировано с OCR Google и Microsoft

- Готовый для бизнеса для автоматизации

Минусы:

- Дорого для пользователей, использующих малый масштаб

Octoparse

Octoparse предлагает извлечение данных с веб-страниц с помощью интерфейса «укажи и щелкни». Он хорошо справляется со страницами с большим количеством JavaScript и динамическими данными.

Плюсы:

- облачный

- Готовые шаблоны для скрапинга

- Извлечение визуальных данных

Минусы:

- Ограниченная гибкость для пользовательских рабочих процессов

ParseHub

ParseHub, известный своим интуитивно понятным пользовательским интерфейсом и рабочими процессами сбора данных на основе экранов, отлично подходит для пользователей, желающих извлекать интерактивный или динамический контент.

Плюсы:

- Легко выучить

- Поддерживает рендеринг JavaScript

- Автоматизация браузера включена

Минусы:

- Медленнее, чем чисто кодовые инструменты для крупномасштабных задач

Апифай

Apify объединяет безголовые браузеры и продвинутое скриптование в универсальную облачную платформу для скрапинга. Ее визуальный интерфейс и поддержка автоматизации делают ее мощным гибридным инструментом.

Плюсы:

- Масштабируемая с бессерверной архитектурой

- Торговая площадка готовых актеров

- Автоматизация браузера с помощью Puppeteer

Минусы:

- Требуется JavaScript-кодирование для сложных потоков

Selenium (с расширениями OCR)

Selenium — это проверенный временем инструмент для автоматизации браузера. В сочетании с библиотеками OCR, такими как Tesseract, его можно использовать для мощных сценариев веб-скрейпинга.

Плюсы:

- Зрелая экосистема с открытым исходным кодом

- Отлично подходит для UI-тестирования и парсинга веб-страниц

- Поддерживает Python, Java, C#

Минусы:

- Требуется ручная настройка OCR и драйверов браузера

Puppeteer (обработка веб-страниц на основе headless-браузера)

Созданный для Chrome, Puppeteer отлично подходит для взаимодействия с динамическими веб-сайтами. Он отрисовывает полные страницы, имитирует действия пользователя и может захватывать отрисованный текст или изображения для скрапинга.

Плюсы:

- Полный контроль над headless Chrome

- Отлично подходит для веб-сайтов с большим количеством JavaScript

- Может делать снимки экрана и PDF

Минусы:

- Поддерживаются только браузеры на базе Chromium

Как выбрать правильный инструмент для скрапинга веб-страниц

Выбор правильного инструмента для веб-скрейпинга зависит от нескольких ключевых факторов:

- Тип данных: Вы соскребаете текст, визуальные элементы или полные рабочие процессы графического интерфейса?

- Масштаб: Вам нужно запускать тысячи парсингов в день или всего несколько?

- Платформа: Вы ориентируетесь на веб, настольные или мобильные устройства?

- Навыки программирования: Вы предпочитаете no-code инструменты или пользовательские скрипты?

Если вы парсите сложные динамические веб-сайты, такие инструменты, как Кукловод или Апифай идеальны. Если вы работаете с старые настольные приложения, UiPath возможно, это ваш лучший вариант. Бюджет и требования к поддержке также играют ключевую роль в принятии решений.

Зарядите свой веб-скрейпинг с помощью NodeMaven

Чтобы сделать ваш веб-скрейпинг еще более надежным и незаметным, используйте инфраструктуру NodeMaven в сочетании с вашим стеком для скрейпинга.

Независимо от того, запускаете ли вы автоматизацию OCR или рендеринг браузера, резидентские прокси необходимы для успеха.

Вот как NodeMaven помогает:

- Вращающиеся резидентные прокси: Убедитесь, что каждая сессия имитирует реального пользователя из реального местоположения, что необходимо для сбора данных с веб-сайтов, использующих надежные механизмы обнаружения.

- Статические резидентские прокси: Для более длительных задач скрейпинга, где постоянство IP-адреса имеет решающее значение, эти прокси сохраняют устойчивую идентичность.

- Скрейпинг браузер: Предстоящий браузерный инструмент NodeMaven обрабатывает рендеринг JavaScript и продвинутое маскирование отпечатков пальцев с поддержкой нативных прокси, что позволяет легко масштабировать скрейпинг веб-страниц.

- Геотаргетинг: Получайте доступ к данным из определённых стран или городов, не вызывая ограничений, основанных на местоположении.

- Круглосуточная поддержка и масштабируемость: Независимо от того, проводите ли вы 10 или 10 000 сеансов, NodeMaven предлагает масштабируемость и поддержку, необходимые для ваших операций по скрейпингу данных.

Независимо от того, извлекаете ли вы данные из устаревших приложений, отслеживаете цены в реальном времени или автоматизируете рабочие процессы контроля качества, скрейпинг веб-страниц является мощным инструментом в 2026 году.

А при интеграции с надежным прокси и стеком браузера, таким как NodeMaven, ваш скрейпинг становится еще более устойчивым, анонимным и эффективным.

Зарегистрируйтесь в NodeMaven сегодня, чтобы начать использовать вашу инфраструктуру для скрейпинга контента с уверенностью и непревзойденной производительностью.